種瓜得瓜 AI也略懂略懂

編譯/陳宣豪

數據中的誤導雜訊

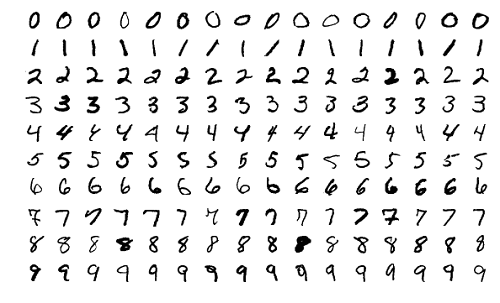

假設我們希望構建一個能辨識手寫數字的AI視覺系統,一般會使用MNIST數據集中大量已被標記的手寫數字圖像訓練神經網絡,都能取得不錯的成果;然而一旦我們在資料中加入其他變項─例如相同數字但有不同色彩─系統準確率便由原先84.3%驟降至僅10%。

現實世界中,我們清楚知道數字符號所代表的意義與書寫時的墨水顏色無關,但在帶有不同色彩的MNIST數據集中,演算法卻誤將「顏色」作為數字辨識的主要依據,而非「形狀」。這種Bottou所謂的「虛假相關」(spurious correlation),使得系統在原先訓練資料的範疇之外,幾乎沒有任何效用。

因果關係

然而由另一個角度出發,Bottou認為:一旦我們排除所有演算法因為誤解資料特性所建立的虛假相關,將會留下或趨近在所有資料集中皆成立的「不變性質」(invariance)。掌握不變性質,機器便可推論出任一干預或變因操作,會對整體資料造成怎麼樣的影響與後果。

舉例來說,數字符號的形狀決定其意義,機器一旦掌握這一點,便可輕鬆推斷出:改變符號形狀(因)也會連帶改變其所代表的數字(果);反之,符號顏色的改變則對其意義沒有影響。這好比我們已知「所有物體都受到重力的影響」,那麼當你放開一顆球時(因),應可推斷它最終會落到地上(果)。

大雜燴不是最佳解

傳統的作法是盡可能將多樣且具代表性的數據都納入單一訓練資料集中,不過Bottou認為這種方法反而適得其反,因為將這些在不同背景、時間與實驗條件下所蒐集的數據合併,反而會丟失重要的脈絡背景,提高演算法建立起虛假相關的可能。

Bottou則採用兩組不同的彩色MNIST數據集來訓練AI。每個數據集都有不同的顏色模式,弱化顏色-意義的虛假關聯,加強形狀-意義之間的連結,最終系統的辨識正確率達70%,證明透過訓練資料的精心設計與安排,演算法也能學會忽略虛假相關,僅關注唯一的不變性質─符號的形狀。

Bottou和其團隊接下來將嘗試比彩色數字更複雜的問題,最終將這樣的想法擴展到我們尚不瞭解的複雜系統,例如應用於經濟模型,我們或許便能預測實施無條件基本收入的效果為何;或者用於全球氣候系統,評估各種人類行為對環境的影響。人工智慧未來或許能協助我們掌握事物背後的成因,並在採取各種措施或行為之前,有更完善的評估。

編譯來源

K. Hao, “Deep learning could reveal why the world works the way it does”, MIT Technology Review, 2019.

參考資料

L. Bottou, “Learning Representation with Causal Invariance (ICLR 2019)”, leon.bottou.org, 2019.

(本文由教育部補助「AI報報─AI科普推廣計畫」執行團隊編譯)