猜物遊戲有助於機器理解人類

編譯|葛竑志

編譯|葛竑志

機器聽懂使用者的需求,再給予合理的答覆,這聽起來早已是Siri、Alxea這類語音助理能輕鬆做到的事情。只要結合前端的語音處理、後端的機器學習架構(像是Seq2Seq),似乎只要給極大量的資料,讓模型持續接受訓練,機器便有望能越來越像人一樣進行正常溝通。

但很多時候,情況並不是這麼地理想。如同片面之詞對人而言可能有不同解讀,對機器來說也是一樣的道理。要如何能幫助機器理解人類的語意,便成了一些資料科學家著眼之處,這裡要介紹的與神經網路架構無關,而是站在訊息模型的角度,嘗試找出有效溝通的方法。

●為何有效溝通如此重要

最近由美國陸軍研究實驗室(U.S. Army Research Laboratory, ARL)與密西根大學(University of Michigan, UM)合作的研究已發展出新的技術,不僅助於降低機器理解錯誤的機率,還有望能使人工智慧適應各種複雜的場合。

「人工智慧的應用早已充斥於日常生活中,像是手機,它們特別適合回答特定類型的問題。」ARL的Sadler博士說:「但情況若是在緊張的軍事環境中,就非常不同了。問題往往只有幾個目的,同時也沒有充足的時間讓人進行完整對話,因此我們希望機器要能在和人們的一系列問答,還有隻字片語中快速釐清重點。」

●是非題遊戲

讓機器聽懂人們的重點?或許可以不用想得這麼複雜。

有個想法啟發自1950年代,在美國蔚為流行的娛樂節目「Twenty Question Game」。在這個猜物遊戲裡,挑戰者最多只能向主持人提出二十個問題,若能在時限內猜出答案便能獲得獎金。有趣的是,在遊戲過程中規定挑戰者只能提出是非題,像是「它比麵包盒還大嗎?」、「它是活著的嗎?」這樣,更增添了不少難度。

研究團隊將遊戲的想法推展至人類與機器的溝通:機器試圖找出人類想法中的核心,然後人類針對機器的提問做回應。在這樣的一來一往之間,希望達到機器想推測人類想法的終極目標。或許模仿「Twenty Question」的模式,會是個最有效率的方法。

「人們特別善於回答是或否的問題。」Sadler還說,機器必須能在越少的問題中快速釐清主旨,並強化每一對問答隱藏的價值。「總不能讓處在危險之中的士兵還要拼命解釋情況吧?」

●建立資訊傳遞模型

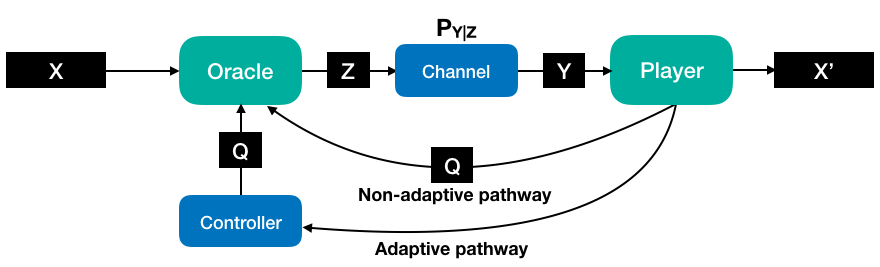

在論文中,團隊將焦點放在資訊傳遞(Information transaction)的理論上。為仿造人機溝通的情況,他們建立了一個模型,其中存在著兩個重要角色:Oracle,答案X的持有者,負責接收來自Player的問題Q,給出一個回應Z。另一位稱作Player,則是負責根據Oracle的回應Z,猜出答案X',並在下一次的迴圈中向Oracle提出問題。

就像是人在緊張的時刻,容易提供錯誤的資訊。也許Oracle始終明白答案是X,但卻不小心給出了可能不是那麼正確的描述Y。所以由Oracle輸出的資訊會通過一道帶有雜訊的Channel(在上圖中,以條件機率表示),再送到Player的手上。

另一方面則在於,提問的順序使否需要根據Oracle的回應做適應性(Adaptive)的調整。這就好比在「Twenty Question」中,由於提問次數有限,玩家得要就現有資訊,提出最有價值的問題。在論文的模型裡,便以回授(Feedback)的方式將Y傳遞給Controller,並由它決定在下個迴圈該提出哪個問題。

說了這麼多,整個模型其實可以簡述成一個通訊系統,在有雜訊干擾的情形下,試圖讓Player推估的答案X'與Oracle持有的答案X越接近越好。這裡就使用了常見的通道編碼(Channel coding)策略[註一],Unequal error protection(UEP)[註二]以及衍伸的編碼方法Superposition coding。

●有望產生更有效的對話方式

詳細的數學推導過程在此不多說,但就結果而言,團隊是想出了特別的編碼策略,能夠使X與X'的方均差,以更快的速度收斂(定義迴圈數為N,則原始方法的速度為指數項根號N,新方法則可達到指數項N)。換句話說,在這樣的架構下使得每次的問答都更具有意義,幫助Player(機器)能更快地了解Oracle(人類)的持有資訊。

ARL表示,這樣的研究方法還在持續著,除了遊戲的想法以外,還在探索更有效率的架構,希望能在不遠的未來促成人工智慧與士兵的合作模式。

[註一]:在通訊系統中為了避免訊息遭到雜訊干擾,造成訊息的失真,會藉由特殊的編碼方式,幫助收發端辨認訊息的真偽,有興趣可參見[3]

[註二]:一種在重要資訊(Most significant bits)上做較多保護,若不重要則保護較少的編碼策略。

編譯來源:

U.S. Army Research Laboratory. "Scientists help robots understand humans with 20 questions game idea." ScienceDaily. ScienceDaily, 7 March 2018.

參考資料:

[1] Hye Won Chung, Brian M. Sadler, Lizhong Zheng, Alfred O. Hero. Unequal Error Protection Querying Policies for the Noisy 20 Questions Problem. IEEE Transactions on Information Theory, 2018; 64 (2): 1105 DOI: 10.1109/TIT.2017.2760634

[2] ARL Public Affairs. Army scientists help robots understand humans. Feb. 2018.

[3] 葉丙成,「為何傳簡訊、email 很少出錯? 漫談通訊與通道編碼技術」