以意念操控AI:仰賴人腦與電腦雙向學習的腦機介面

編譯/吳奕萱

2016年,第一屆「人機合體」運動會(Cybathlon)在瑞士蘇黎世舉行。其中的腦機介面項目,像極了一場電玩競賽:選手須利用腦波操縱虛擬角色(avatar)精準執行指定任務。來自蘇黎世聯邦理工學院(Eidgenössische Technische Hochschule Zürich,ETHZ)的團隊發現,操縱效能的關鍵在於讓人腦與機器相互學習(mutual learning):除了機器要學習處理腦波訊號的最佳模式外,程式設計者也要保留空間讓使用者熟悉機器運作模式,學習發出更清楚的控制指令。

腦機介面

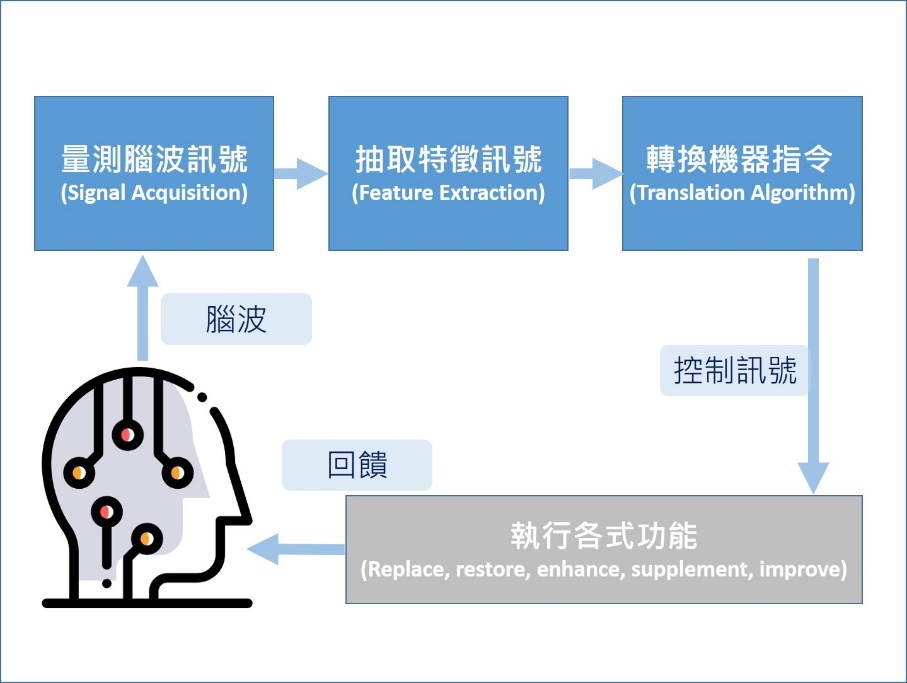

圖一 腦機介面系統(資料來源:參考資料[1])

「腦機介面」利用腦波電訊號,進行人與機器間的溝通,令患者得以操控電動輪椅,或利用機械手臂抓取物品。使用者以視覺觀察周遭環境後,思緒專注於欲執行的動作,所產生的腦電波(Electroencephalogram, EEG)經放置於頭部表面的非侵入式電極貼片,單點或多點接收,傳至電腦軟體。電腦對EEG訊號進行前處理與特徵抽取,產生特徵映射(feature map)並進行分類(classification),成功解碼後便能據此控制物體。近年來腦機介面相關研究主要著重於訊號的取得,以及訊號的處理與演算。在此案例中,EEG訊號由貼附於頭皮的無線乾電極所收集,相較於經手術由大腦皮層收集,具有低侵入性及操作流程簡便的優點。演算法的研究,則包括如何辨識EEG訊號並抽取特徵、降低雜訊干擾以及如何根據個體差異,調整控制裝置的動作,提升可靠度。

由於量測到的EEG訊號,其實是多個神經元放電後相互疊加的結果,因此研究人員必須分析使用者大腦在執行不同任務時的腦波特徵,找出有助於判讀使用者意圖的線索。其中,視覺刺激電位(Visual evoked-potential,VEP)與事件相關電位(Event-related potential,ERP),隱含許多與腦部活動及功能相關的腦波特徵。而獨立成分分析(Independent Component Analysis),則能有效分離因眨眼產生的肌電訊號(EMG)以及背景電磁干擾[3]。隨著機器學習技術的發展,能識別關鍵EEG波形的演算法亦有長足進步,得以更精確地解析EEG訊號,理解使用者「意志」。

人類也要學習機器的運作模式?

除了藉由機器學習提升EEG訊號的識別準確度之外,有什麼方法能讓訊號特徵更加明顯,從源頭改善問題呢?ETHZ研究團隊於是訓練兩名脊髓損傷患者,參加「人機合體」的比賽項目。在嘗試多種腦機介面系統後,他們得以精確控制螢幕上的虛擬角色,在比賽中旋轉、跳躍與滑行,且穩定行走不絆倒。

當操作者的大腦處於放空狀態時,角色會以中等速度前進;若正確執行任務,則加速;錯誤動作,則減速。經過數月訓練,兩位受試者最終在競賽中擊敗了其他十位參賽者,獲得金牌,並創下大會紀錄。他們認為分數提高最大的關鍵:在於使用者若能對機器的判讀模式有所了解,調整自己的控制方式,便可大幅降低機器校正的頻率[2]。

研究結果顯示,經雙向訓練後,機器判讀兩位受試者動作的平均準確度,分別由53.8 % 提升至 93.8 %;81.9 % 提升至96.8 %。而所有動作中,「旋轉」的判讀正確率最高。

由此可知,當使用者試圖控制虛擬角色時,腦中因同時想像著同樣的動作,而產生的感覺運動節律(sensorimotor rhythm),會隨著使用的時間與累計次數,愈來愈清晰。與投籃相似,因熟練而生巧,逐步掌握適當的力度與角度。同理,若機器重新校正的頻率過高,使用者反而難以掌握溝通訣竅,機器判讀的精確度亦難以提升。

雙向學習,創造雙贏

以往的機器學習著重於機器單方面的學習與判讀。而此研究團隊則從另一角度出發,讓使用者也能學習產生更清楚、有明顯特徵的EEG指令。雙向學習讓人腦與電腦得以相互學習、共同成長。不僅使得機器有更高的指令成功辨識率,使用者操作起來也更「得心應手」。

編譯來源

Brain-computer interface based on mutual learning helps tetraplegics in avatar race: Mutual learning as key to translational brain-computer interface ScienceDaily, 10 May 2018.

參考資料

- BNCI (Brain/Neural Computer Interaction) Horizon 2020, “About BCIs”, 2015.

- S. Perdikis, L. Tonin, S. Saeedi, C. Schneider, J.R. Millán. “The Cybathlon BCI race: Successful longitudinal mutual learning with two tetraplegic users“. PLOS Biology, 2018.

- 徐聖修,「腦機介面 (Brain-Computer Interface) 專題」,2014.

- D. Novak , R. Sigrist, N.J. Gerig , D. Wyss, R. Bauer, U. Götz, et al. “Benchmarking Brain-Computer Interfaces Outside the Laboratory: The Cybathlon 2016.” Front Neurosci. 2018.

- U. Chaudhary , N. Birbaumer , A. Ramos-Murguialday. “Brain-computer interfaces for communication and rehabilitation.” Nat Rev Neurol. 2016.

- ETH Zurich, “Cybathon – moving people and technology”

(本文由教育部補助「AI報報─AI科普推廣計畫」執行團隊編譯)