不知為不知的智慧

編譯/臺大資工所 許晉華

過度自信

芝加哥伊利諾伊大學資工教授Brian Ziebart指出:現有的機器學習模型,大多假設未來事件會與過往經驗相似;因此,當新物件出現時,系統通常會太過自信,以訓練資料集中的資料來推估新物件,即使兩者沒有或只有很少的共通點。

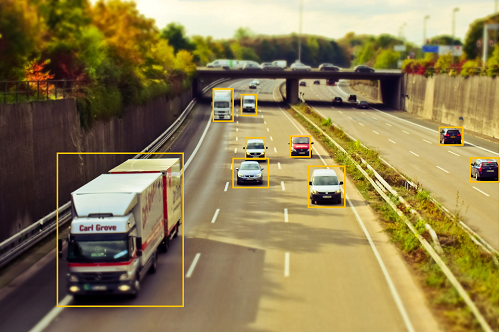

例如將電腦視覺應用於自動駕駛車輛時,系統會追蹤並以邊框標記視線範圍內物體。在光線充足、視線清楚的情況下,若原先的訓練資料集大多是在此類環境下所拍攝的影像,則AI表現出色;然而現實世界並非總是如此單純:當天氣轉陰時,AI的辨識準確率或可由晴天時的80%,驟降為40%。設想延伸應用至夜間道路時,會有怎樣的後果?

另一方面,人類的應對,在此處卻有可取之處。當人類遇到意外狀況,例如一駕駛發現道路前方出現未知物體時,並不會直接超車越過,而是選擇將車速降下來,觀察其他駕駛的反應後,或急轉彎,或採取其他動作。一般來說,在情勢明朗前,人類傾向謹慎行事,避免鑄下大錯。Ziebart希望AI在類似情況下,也能以同樣的謙遜與謹慎態度應對。與其衝動行事,不如承認當前的不確定性,提出疑問,以取得更多的資訊。

熟悉環境中的未知

Ziebart認為:既然再多的訓練與驗證,也無法含括所有的可能狀況,不如在資料集中混入雜訊,幫助AI「意識」到自己可能身處未知事件中。人類本身看待事物的觀點與角度,便或多或少存在著灰色空間,藉由招募不同人員來標記影像中的物體邊界,也勢必會得到迥異結果,反映了現實中的混亂。透過接觸大量困惑且相互矛盾的資料,期待AI在預測時,也能同時考慮不確定性,提醒系統在遇到新事件時,應保有謹慎態度,並向外尋求更多資訊。

當然,在自駕車的例子中,恐怕沒有足夠的時間讓AI在發現異物時尋求協助,但至少能意識到在第一時間應當減速慢行。

機器學習的下一步

Ziebart認為如何讓AI意識到自己所受訓練的不足,是AI設計的基本課題之一。其所研發的系統目前仍處於實驗階段,藉由提供混雜且多變的資料,AI的預測結果和人類標記邊界的重複面積,已可逾七成以上。另與芝加哥伊利諾伊大學Sima Behpour和卡內基梅隆大學Kris Kitani的合作結果,Ziebart的混沌AI在ImageNet物體偵測任務中,成功辨識率甚至較目前表現亮眼的資料增強 ( data augmentation ) 法相比,還高了16%,已是相當優異的成果。

編譯來源

Tucker Davey. “How AI Handles Uncertainty: An Interview With Brian Ziebart.” Future of Life, 2018.

參考資料

S. Behpour, K. M. Kitani, and B. D. Ziebart. ADA: A Game-Theoretic Perspective on Data Augmentation for Object Detection. Arxiv.org, 2018.