機械手臂靈巧性再升級

編譯/許晉華

難題與解決方案

以往機械手臂的程式多被寫死,因而限制了可執行的指令內容,因此研發團隊紛紛改以機器學習來開發新一代的機械手臂,但機器學習的訓練過程需要耗費大量時間,並不斷地重複相同動作,容易耗損硬體設備,對於機械手臂這種精細度高的硬體而言更是一大傷害;就此問題團隊提出替代方案,改用模擬設備來訓練演算法,然而畢竟實體和模擬設備不全相同,要直接將演算法套用至現實中仍有一段差距要克服。

為此,研究團隊在不微調演算法的前提下,在訓練過程中隨機加入一些變數,例如摩擦力、欲操控之物體大小等,並賦予機器人短期記憶,如此一來,Dactyl經過一段時間便能掌握物體確切的大小和其他參數,並隨之調整。

學習架構

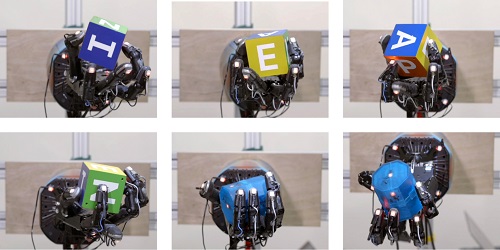

OpenAI團隊採用Shadow Dexterous Hand作為系統輸出的硬體設備。該機械手臂有24個活動關節,遠超出其它機械手臂(平均僅7個)。研發團隊主要是將六面印有不同色塊和字母的正方體積木放置在機器手臂的掌心中,要求它轉動至指定方向。Dactyl的核心演算法為強化學習,其中更結合了兩套類神經網路──操控網路和視覺網路。

首先,操控網路以LSTM架構(Long short-term memory,具記憶的神經網路)來學習環境中的動力學,並沿用OpenAI在Dota2電競比賽中開發的強化學習訓練系統Rapid。由於Rapid動用了六千餘顆CPU和8顆GPU來加速,讓Dactyl僅需50小時就能蒐集相當於100年的學習經驗,這也正是該系統能達到高靈巧性的主要原因。而視覺網路則是基於CNN架構,研究團隊在手臂上方架設三台相機鏡頭,將其接收到的影像作為輸入,經視覺網路學習後,輸出估計的積木的方向和位置資訊。操控網路用以執行手臂操作,而視覺網路則讓手臂得以「看見」積木,透過這兩個網路Dactyl可以更嫻熟地操控機械手臂、完成指定任務。

高靈巧性的展現

由研究團隊提供的影片中,可以看出成果相當不錯。機械手臂在虛擬實境中歷經相當百年的反覆試驗後,能順利連續執行30種不同的方向指令,靈活地轉動方塊,將積木轉動至指定方向(例如將印有「A」的一面朝上、「P」面朝外等),落實操作指令零失誤。測試時團隊將演算法應用至真實手臂上,最高紀錄是能完美地轉動方塊至15種方向。研究團隊還發現Dactyl竟在無人教導下學會一些人類的常用手勢,例如:指尖轉動、滑動積木等,另外,在指尖緊握的指令時,Dactyl會使用大拇指和小指,然一般人都是用大拇指和食指或中指,就此研究團隊認為是因機械手臂上小指較其它手指還多出一個關節的原因,這也代表著Dactyl不僅會摸索出人類常用手勢,甚至會根據機械手臂的機能來做出改變。過去從未有機械手臂能完成如此精巧又複雜的操作指令。

結論

從Dactyl的成果中研究團隊也得出幾個結論。首先,觸覺功能的偵測器並非必要。例如實驗中僅使用到方向和位置資訊,亦能順利完成任務。再者,只要對單一物體作出隨機的參數調整,就能讓系統具有概括性,不必再針對特定物體進行調整。除此之外,他們也發現一味壓低反應時間並不會有更好的成果:Dactyl每執行一個指令約需80ms的反應時間,一般人類則是介於150-250ms之間,當團隊試圖將反應時間降至40ms時,成果並沒有顯著的提升,反而讓訓練過程更加耗時。

Dactyl在靈巧度上的亮眼表現也許能將機械手臂帶領至下一個里程碑,未來機械手臂將有機會執行難易度更高的任務,組裝更精密的零件、參與手術,抑或是提升家庭機器人的實用性。無論是何種應用方向,皆是人類之福。

編譯來源

M. Huston, “Watch a robot hand learn to manipulate objects just like a human hand”. Science, 30 July 2018.

參考資料

OpenAI. “Learning Dexterity”. OpenAI, 30 July 2018.

(本文由教育部補助「AI報報─AI科普推廣計畫」執行團隊編譯)