無用之用 AI也需要多元、適性發展

OpenAI設計了一系列看似沒有商業利用價值的AI。然而它們是真的毫無是處?還是我們看不見它們的價值?

編譯/江彥成、黃思齊

●進擊的走路機

走路機拖著累贅般的左腿,一跳、一跳地抖動前進著,幾百公里之後,才終於顫顫巍巍地走出第一步。它經常卡在斜度10度的坡道上動彈不得,還稱不上學會走路。走路機的創造者──Uber AI實驗室的研究員Rui Wang與前同事Jeff Clune──習慣把電腦開整夜,滿懷期待地在隔天上班時打開螢幕,看看走路機又會摸索出什麼出乎意料的走路方式。

這是一樣稱作POET(Paired Open-Ended Trailblazer,開放配對先驅者)的軟體,裡頭其實包含兩套AI:一組負責產生複雜的地形環境,另一組則不斷嘗試不同的步行策略來攻克前者產生的地形。在無數次失敗的嘗試後,走路機漸漸發展出複雜又自成一格的步伐,過程中完全不需要人類的參與。

POET與我們在新聞中常聽見或看見的AI不同,它不能玩圍棋、無法辨識醫療影像中的癌變組織或預測蛋白質的折疊。POET能做的事看似極其有限,甚至可以說毫無用處,但Wang與Clune對POET其實有更高的期待。

AI到了近代,主要以人工神經網路為主,網路中層層相連的節點建構出輸入和輸出間複雜的數學關係。輸入、輸出之間要包含幾個隱藏層才會有最好的效果?如何調整各節點的參數?這類架構設計的問題,同時也是一個人工神經網路成功與否的關鍵,非常仰賴研究人員的經驗。直到1980年後,科學家開始有了瘋狂的想法:透過AI隨機生成另一個人工神經網路的結構,並自動化地測試該結構的效果。這個作法,稱為NAS(Neural Architecture Search,神經網絡架構搜索)。

2018年開始,Esteban Real和Google的同事利用NAS打造出的一系列圖像辨識模型,與當時最頂尖的人類設計模型相比更小、更快,卻能產生更準確的辨識結果。2020年,Real再一次證明自動機器學習(Automated machine learning,AutoML)的潛力──新一代的AutoML Zero僅透過幾個機器學習背後的基礎數學概念、六行程式碼,從頭構築出複雜的神經網路結構,甚至發展出梯度下降法(gradient descent)這項技能。雖然目前為止還沒有令人意外的突破,但以AI設計AI或許是更高效的模型設計方法。

●人類的侷限

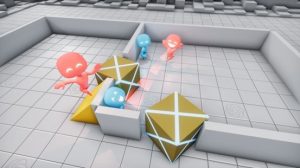

OpenAI曾做過一項有趣的研究:他們在虛擬環境中,讓兩組AI一個當鬼,一個當人,互玩躲貓貓。兩者都可以利用地形,以及移動場地中的障礙物或斜坡來方便自己躲藏或捉人。漸漸地,兩方展開如同生物演化上的軍備競賽,各有千秋,但誰也不能長期壓制對方。

有別於監督式學習(supervised learning)和非監督式學習(unsupervised learning)等機器學習方法,OpenAI透過類似遊戲的場景引導AI做出符合人類期望的行為,這種方法被稱作「強化學習」(reinforcement learning)。強化學習的靈感,來自於行為主義心理學:透過獎勵和處罰(遊戲中的積分),強化生物對特定刺激與反應的連結。

在遊戲中,時間的觀念被導入AI的學習中:在時間點t1時,模型根據接收到的觀察結果O1,做出行動A1並對環境造成影響;在下一個時間點t2,模型再根據A1造成的環境差異(O2-O1),決定自己的下一步。這個流程讓模型懂得「回顧」自己的行動,並能進行長時間的推理。

但隨著時間與遊戲次數的增加,兩組AI都發展出驚人的行為。它們學會如何抄捷徑,利用模擬空間的設計瑕疵來更方便、快速地贏得遊戲,例如:人在鬼可以動作之前將斜坡擠出場外,使鬼無法利用斜坡進入小房間;鬼發現自己可以站在箱子上移動,以「衝浪」的方式進入人所躲藏的小房間。

這樣的結果可以有樂觀與悲觀兩種詮釋。正面來說,AI點出了人類在思想上的侷限,提醒我們應該跳出框架思考;但反過來說,從人類出發的視角與世界觀,或許正是AI發展的最大限制。以前述的POET為例,走路機一路上遇到的木棍、坡道和溝渠,雖然有無限多種組合,但終究是「人類」設下的挑戰。走路機的潛力,或許正被我們的認知所箝制。除了讓AI自行找到可行或最佳的行為策略,要真正做到「以AI創造AI」,更重要的是讓AI成為另一個AI的老師。

OpenAI 另一項研究中的兩隻機械手臂或許是絕佳案例:在虛擬空間中的兩隻機械臂,一隻負責將桌上的積木排列成複雜的形狀,另一隻則致力將積木依序列排好。反覆訓練之後,即使將積木換成西洋棋、盤子或其他物件,後者都不需要另外重新訓練,而能沿用先前的經驗來應對新環境。

●開放學習,開放未來

Clune深深明白,距離真正的AI自我設計演算法(AI-generating algorithms,AI-GAs)還有一段路要走,但POET已經邁出艱難地第一步。在訓練POET的過程中,隨機轉換環境是非常關鍵的。走路機無論是卡住或匍匐前進,不斷地給予難易不一、意想不到的新環境,有助於模型在強化既有技能和發展新技能中取得平衡。

然而放手讓AI設計AI,也同時意味著我們無法控制AI的行為,也無從預測AI的表現。自學產生的AI,或許會比現在的「黑盒子」更難為人類理解,屆時要人為校正幾乎是不可能的!人類必須重新思考AI的應用與研究倫理,並與模型的設計效率取得平衡。但這只是開始,Clune強調,正視AI自我學習的潛力,讓更多人加入討論,才是他現階段的目標。

編譯來源

- Heaven, W. (2021). AI is learning how to create itself. MIT Technology Review.

參考資料

- Baker, B., Kanitscheider, I., Markov, T., Wu, Y., Powell, G., McGrew, B., & Mordatch, I. (2019). Emergent Tool Use From Multi-Agent Autocurricula. arXiv.org.

- Clune, J. (2021). AI-GAs: AI-generating algorithms, an alternate paradigm for producing general artificial intelligence. arXiv.org.

- Plappert, M., Sampedro, R., Xu, T., Akkaya, I., Kosaraju, V., & Welinder, P. et al. (2021). Asymmetric self-play for automatic goal discovery in robotic manipulation. arXiv.org.

- Someda, T. (2018). Using Sparse Modeling in AI: A Human Centric, Explainable Approach. HACARUS INC.

- Wang, R. (2021). POET: Endlessly Generating Increasingly Complex and Diverse Learning Environments and their Solutions through the Paired Open-Ended Trailblazer. Uber Engineering Blog.

(本文由教育部補助「AI報報─AI科普推廣計畫」執行團隊編譯)