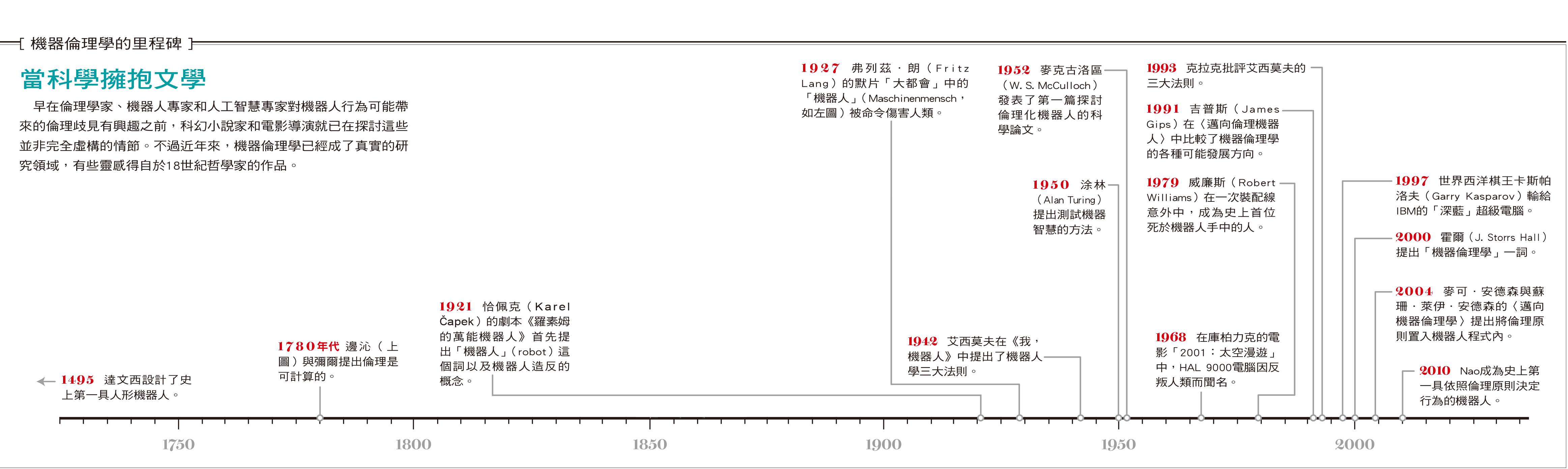

機器人也懂倫理(1/2)

撰文╱Michael Anderson & Susan Leigh Anderson|譯者╱甘錫安

轉載自《科學人》2010年11月第105期

重點提要

- 可自主做出決定的機器人,例如用於協助老人生活的機器人,即使在看似平常的狀況下,也可能面臨倫理困境。

- 確保機器人能以合乎倫理的行為與人類互動的方法之一,是將一般倫理原則輸入機器人,並讓機器人在各種狀況下運用這些原則做出決定。

- 人工智慧技術可借助邏輯,由各種倫理上可接受的行為案例中,自行歸納、產生原則。

- 本文作者依據此方法,把程式寫到機器人裡,做出第一個依據倫理原則行動的機器人。

機器人聰明到足以挑戰人類,是驚悚科幻小說裡常見的恐怖情節,而且機器人絕對不會因為傷害甚至毀滅人類而感到絲毫內疚。當然,目前機器人的用途大多是幫助人類,但即使在相當平常的狀況下,機器人也會面臨許多倫理上的挑戰,而人工智慧也不斷在突破這些困境。

想像一下,機器人可能很快就會出現在安養機構,而你就住在安養機構裡。接近上午11點時,你要娛樂室裡的機器人幫你拿遙控器,好讓你打開電視收看「超級星光大道」。但另一位住客也想拿遙控器,因為她想看「全民估價王」,最後機器人決定把遙控器拿給她。剛開始你有點不高興,但機器人解釋這個決定很公平,因為你今天已經看過你最喜歡的晨間節目。這個故事是很平常的倫理決策行為範例,但對於機器人而言,卻是十分難以達成的重大成就。

前面描述的狀況只是理論上的模擬,但我們已經製作出第一款能做出類似決定的示範機器人。我們賦予這具機器人倫理原則,讓它能依照這個原則決定該隔多久提醒病患吃藥。機器人的程式目前只能從少數幾種可能的選項中選取其中之一,例如是否要一直提醒病患吃藥與何時該提醒,或是什麼狀況下該接受病患不吃藥的決定,不過就我們所知,這是第一款依據倫理原則決定行動的機器人。

但要預測機器人可能面臨的所有抉擇,並將之寫入程式,讓機器人在各種想像得到的狀況下都能妥善處理,卻相當困難,可以說是不可能。但另一方面,如果完全不讓機器人採取需要做出倫理抉擇的行動,又可能限制機器人執行得以大幅改善人類生活的任務。我們認為,解決方法是讓機器人能將倫理原則運用在預料之外的新狀況下,好比說除了判斷該讓誰拿遙控器之外,還可以決定該讓誰看新書等。這種方式還有一個優點,就是當機器人被要求解釋自己的行為時,可以參考這些原則。如果要讓人類自在地與機器人互動,這點十分重要。另外一個附加優點則是,倫理機器人的開發工作,也可促使哲學家探究日常生活狀況,帶動倫理學這個領域本身的進步。就像美國塔弗茲大學哲學家鄧奈特(Daniel C. Dennett)最近說過的:「人工智慧使哲學更誠實。」

我,機器人

不久之後,具有自主能力的機器人可能就會成為日常生活的一部份。現在已經有飛機能夠自己飛行,能自動駕駛的汽車也已進入開發階段,連從燈光到空調等一切運作都由電腦控制的「智慧型住宅」,也可想成是身體就是房屋的機器人,庫柏力克的電影「2001:太空漫遊」中的HAL 9000,其實就是一部自動化太空船的大腦。目前已有數家公司正在開發能協助銀髮族打理日常生活的機器人,除了可以協助安養機構人員工作,也可幫助長者在家中獨立生活。儘管這類機器人大多不必做出攸關生死的決定,但要讓一般人接受它們,必須先讓大眾認為它們的行為公平正確,或者至少是良善的。因此,機器人的研發人員最好能將程式會帶來的倫理歧見列入考量。

如果你也認為將倫理原則置入具有自主能力的機器人,是機器人與人類順利互動的關鍵,那麼第一個問題就是應該置入哪些原則?科幻小說迷可能會認為,艾西莫夫(Isaac Asimov)多年前已經提出了答案,那就是著名的「機器人學三大法則」:

1. 機器人不得傷害人類,或者坐視人類受到傷害而袖手旁觀。

2. 除非違背第一法則,機器人必須服從人類的命令。

3. 在不違背第一及第二法則的情況下,機器人必須保護自己。

艾西莫夫於1942年在一篇短篇小說中首次提出這三項法則,但已經有些人在探討該篇小說時,發現了其中的矛盾。艾西莫夫自己也在1976年的短篇小說《變人》(The Bicentennial Man)中描述這些法則有多麼不合宜。在這篇小說中,壞人要機器人拆解自己。在第二法則下,機器人必須遵守壞人的命令;又不可能在不傷害人類的狀況下自衛,因為這樣就違反了第一法則。

如果艾西莫夫的法則行不通,又有什麼其他方案?真有其他方案存在嗎?有人認為,讓機器人做出合於倫理的行為是痴人說夢,他們表示,倫理不可能透過計算得出,因此也不可能寫入機器人的程式中。不過早在19世紀,英國哲學家邊沁(Jeremy Bentham)和彌爾(John Stuart Mill)就主張倫理決策是一種「道德計算」。他們反對以主觀意識為基礎的倫理,提出享樂的行為效益主義(Hedonistic Act Utilitarianism),主張將所有相關人等感受到的愉悅單位數加總並減去不愉悅單位總數,可望達成最大「淨愉悅」的行為,就是正確的行為。倫理學家大多懷疑此理論是否真能涵括倫理考量的所有面向,舉例來說,這個理論很難考量到公義程度,而且可能導致犧牲個人來成全大多數人利益的狀況。但這項理論至少證明了,可信的倫理理論原則上可以計算出來。

有些人懷疑機器人是否真能做出倫理決策,因為機器人缺乏感情,無法體會人類受機器人行為影響時的感受。但人類又很容易受感情左右,經常因此做出不合倫理的舉動。人類的這項特質,加上我們容易偏袒自己和親近的人,使人類在倫理決策方面的表現並不理想。我們認為,受過適當訓練的機器人或許可做到絕對公正,而且雖然本身沒有感情,但能察覺人類的感情,並將之列入計算。(待續)

(本文由教育部補助「AI報報─AI科普推廣計畫」取得網路轉載授權)