機器人也懂倫理(2/2)

撰文╱Michael Anderson & Susan Leigh Anderson|譯者╱甘錫安

轉載自《科學人》2010年11月第105期

由範例學倫理

假設我們能將倫理規則輸入機器人,那麼應該輸入誰的倫理規則呢?畢竟到目前為止,還沒有人能夠提出放諸四海皆準的通用倫理原則,讓真正的人類遵守。但機器人通常是在特定某些地點工作,在這個前提下決定行為倫理參數,會比制訂通用規則來判定行為是否合乎倫理簡單得多,而後者其實就是倫理學家想做的事。不僅如此,在描述機器人可能運作的各種背景下發生特定狀況時,針對哪些事情在倫理上允許、哪些不允許,倫理學家也大多有共識;如果沒有這類共識,就不該讓機器人自行做決定。

研究人員已經提出很多種擬定機器人行為規則的方法,大多是透過人工智慧技術。舉例來說,日本北海道大學的荒木健治(Kenji Araki)和瑞普卡(Rafal Rzepka)在2005年提出了「民主式演算法」。這種方法是在網路上發掘資訊,看看一般人認為哪些行為在倫理上可以接受,再使用統計分析,針對新問題找出答案。2006年,加拿大溫莎大學安大略分校的瓜利尼(Marcello Guarini)提出以現有的案例訓練類神經網絡,讓機器人之後在類似的狀況下能辨識並選擇合乎倫理的決定。類神經網絡是效法人類大腦學習方式的演算法,能學習如何處理資訊,而且處理效率會越來越高。

從研究結果看來,我們認為倫理決策必須在數種責任間取得平衡,倫理學家稱這些責任為初步責任(prima facie duty)。我們通常會將這些責任全部負起,但某個責任在某些時候可能會被另一個推翻。舉例來說,一般人通常會履行承諾,但如果違背某個不重要的承諾可以防範許多傷害,食言也是人之常情。當責任彼此衝突時,倫理原則就可決定在不同的狀況下,應該優先考慮哪個責任。

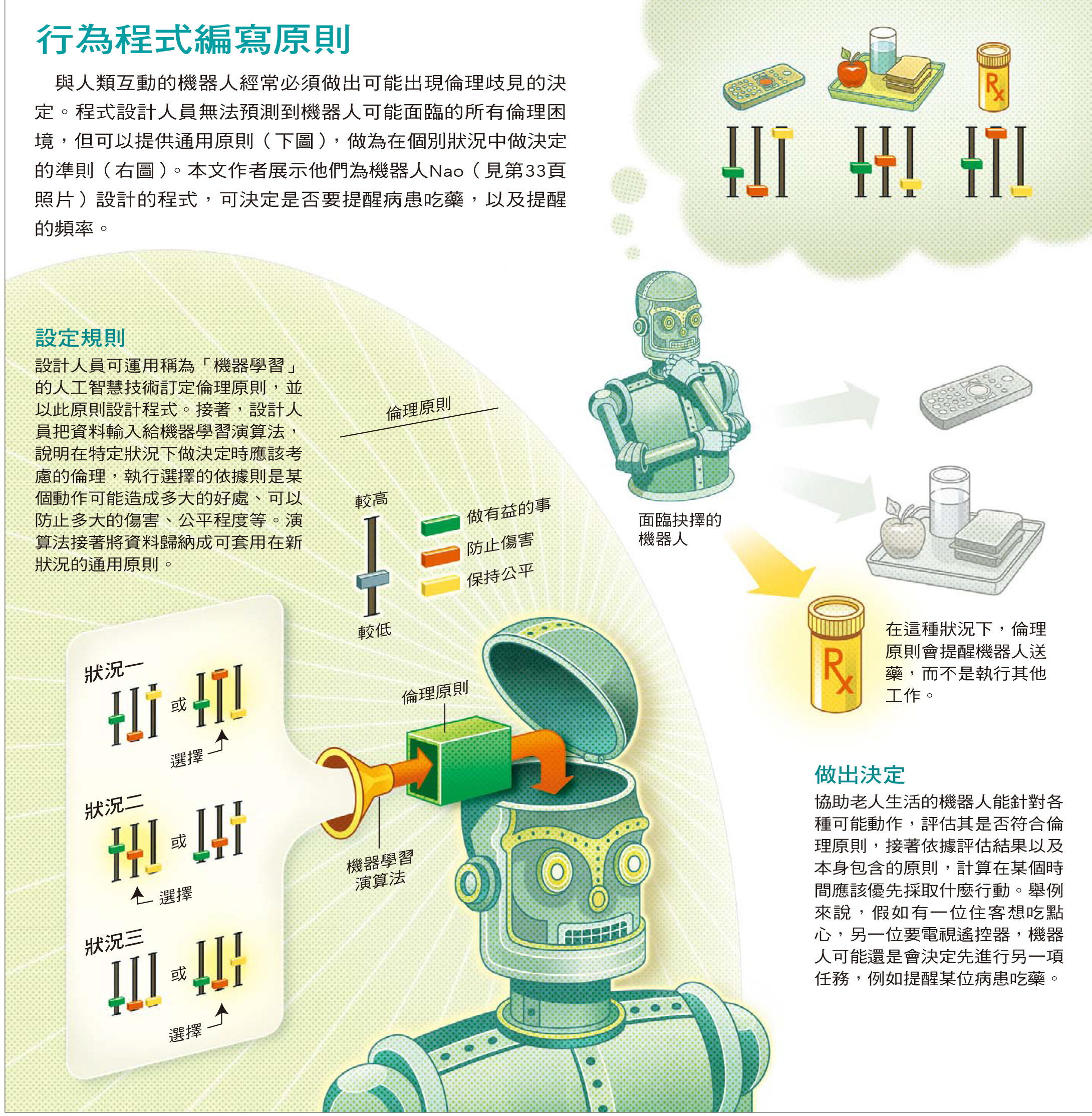

為了制訂可以輸入機器人的倫理原則,我們採用稱為「機器學習」的人工智慧技術。我們首先累積各種特殊案例到具有代表性的數量,以及在這些案例中一般認為合於倫理的決定,讓演算法消化這些資料。接著使用歸納邏輯法,歸納出倫理原則。這種「學習」階段在軟體設計時進行,再將得出的倫理原則放入機器人的程式中。

我們為這個方法設計的第一個測試情境,是機器人必須提醒病患吃藥,同時在病患不聽話時通知管理人員。機器人必須在三種責任間權衡:確保病患獲得吃藥帶來的好處、防止不吃藥可能造成的壞處、尊重成年且有行為能力病患的自主權。在醫學倫理中,尊重病患自主權尤其重要,如果機器人太常提醒病患或太快向管理人員告狀,就可能違反這個責任。

輸入特殊案例的相關資料後,機器學習演算法就訂定出以下的倫理原則:當其他做法都難以避免傷害,或是與增進病患福祉的責任背道而馳時,健康照護機器人應該挑戰病患的決定,也就是違反病患的自主權。

倫理機器人上場

接著,我們將這項倫理原則輸入法國隨從機器人公司(Aldebaran Robotics)開發的人形機器人Nao中。Nao能尋找並走向需要提醒吃藥的病患,將藥送給病患,用自然語言與病患互動,並在必要時以電子郵件通知管理人員(在這裡通常是醫師)。管理人員會先把下列資料輸入給Nao:服藥時間、如果不服藥可能造成的最大傷害、最大傷害可能多久會出現、服藥的最大預期效益,以及這項效益的消失時間。機器人可藉由輸入的資料,計算這三項責任的滿足度或違反度,並依據這些程度隨時間改變的狀況,採取不同的行動。根據倫理原則,當責任滿足度與違反度到達一定門檻,讓提醒比不提醒來得好時,機器人就會發出提醒。等到病患可能因不服藥而受到傷害或喪失重大權益時,機器人才會通知管理人員。

經過充份訓練的老人照護機器人(簡稱EthEl,姑且叫艾瑟兒),需要更複雜的倫理原則,來規範更多種的行為,但一般方法仍然相同。在安養機構中工作時,機器人將以此原則判定各項責任的優先順序,以下是安養機構中的一天。

清早,艾瑟兒站在角落充電。電池充飽之後,它的「善行」(做有益的事)責任優於維護自己的責任,於是它開始在房間中走動,看看住客,問問有沒有什麼事需要幫忙,例如拿飲料或是傳口信給另一位住客等。當它接收到任務時,它會判斷這項任務中每一項責任的初始滿足度與違反度,例如一位看來很不舒服的住客要它幫忙找護士來,忽視住客的不適就會違反「惡行」(防範傷害)責任,使這項任務的優先性高於執行善行責任,因此它去找護士,通知她有位住客需要協助。這項任務結束後,它的善行責任優先權又提高,因此它繼續在房間中走動。

時鐘指向上午10點時,該提醒某位住客吃藥了。這項滿足善行責任的任務立刻成為第一優先,因此它找到這位住客,拿藥給他。後來,這位住客看電視入了神,可能是在看「超級星光大道」或者是「全民估價王」。由於沒有其他待履行的責任,而且電池電量也越來越低,艾瑟兒發現它越來越違反自己的責任,因此趕緊回到充電的角落。

機器倫理學的相關研究才剛剛起步。儘管還相當粗淺,但研究成果讓我們得以期盼,機器擬定的倫理原則可用於規範機器人的行為,使人類更能接受機器人。為機器人灌輸倫理原則相當重要,因為如果人類懷疑有智慧的機器人行為可能違反倫理,就可能完全拒絕具有自主能力的機器人,人工智慧的發展也將面臨威脅。

機器倫理學可能將逐步影響倫理學的研究。人工智慧相關研究的「實用」觀點,可能會比學院派倫理學家的抽象理論,更能掌握大眾心目中合乎倫理的行為。經過適當訓練的機器人,行為可能比許多人類更合乎倫理,因為機器人可以做出公正的決定,而人類在這方面往往並不擅長。說不定在與倫理機器人互動之後,還能督促我們自己的行為更加合於倫理。(完)

(本文由教育部補助「AI報報─AI科普推廣計畫」取得網路轉載授權)