運用AI技術,讓你球神上身!

編譯/許守傑

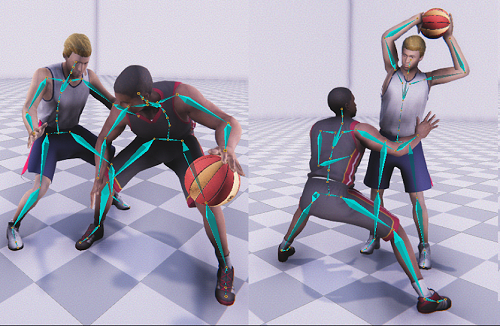

哇!好像真的一樣

2020年全球因COVID-19疫情的衝擊,許多產業都呈現負成長;但各國的封城或隔離措施反倒帶動了宅經濟,使得電玩市場強勁成長、營收持續攀高。相信不少讀者在這段無法隨意出門的期間也是躺在沙發上,在虛擬世界中扮演阿牧帝王意識一波或是操作雷霸龍蹂躪籃框。然而常玩運動遊戲的玩家可能會發現,快速的節奏和動作變化是人物角色動畫的關鍵挑戰:順不順暢、合不合乎真實世界的物理體驗就成為遊戲品質的指標之一。恰好今年在SIGGRAPH(電腦圖學的年度盛會)上就出現了一篇遊戲大廠藝電(Electronic Arts,EA)的有趣研究,以AI合成高品質的角色動作動畫,使得遊戲畫面更自然、豐富。

以籃球比賽為例,球員在運球的同時也會有各種動作或腳步來防守或欺騙對手,這時角色與角色、物體(籃球)與環境之間有多個接觸點,電腦需要在短時間內同步處理這些複雜的交互行為,先前的模擬技術在尺度、真實度和變化性上都還相當受限,遊戲裡的球員難免看起來動作生硬。身兼藝電AI科學家與愛丁堡大學博士研究生的Sebastian Starke與其團隊提出了一種新方法,結合局部動作相位(local motion phases)產生更流暢的人物運動動作。

怎麼做到的?

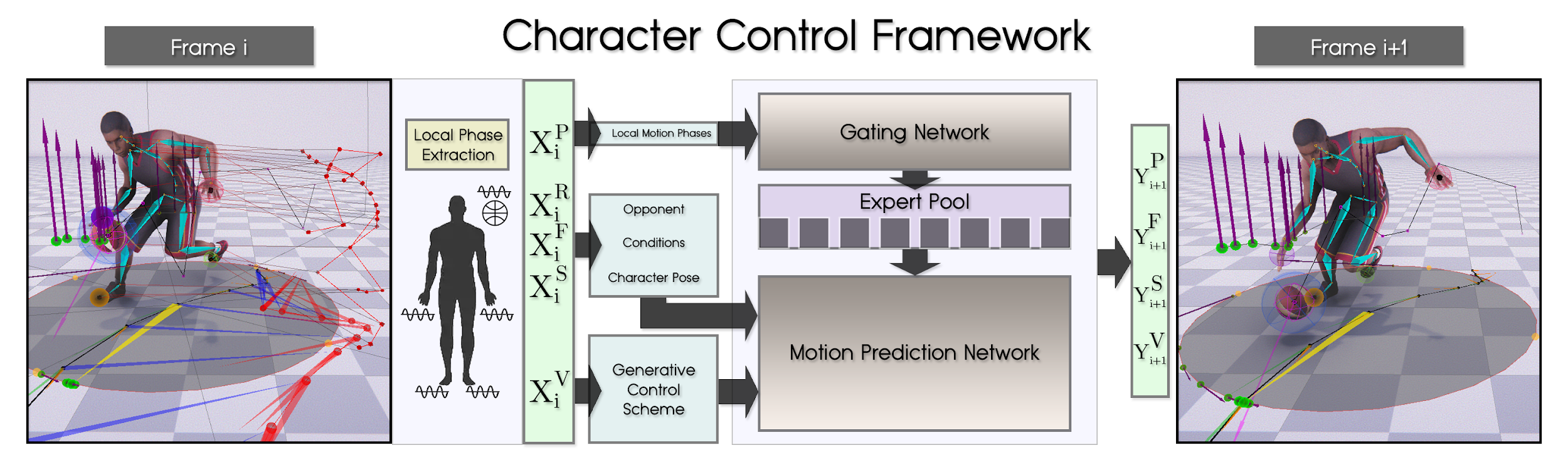

首先,Starke等提出的系統架構屬於多專家學習框架(Mixture of Experts),並由「閘門網路模型」(Gating network)和「動作預測模型」兩大模型組成:「閘門網路模型」同時訓練多個任務專家組成專家群(Expert pool),並運用閘門網路作為每個專家的預測權重計算,用以產生專家混合係數;「動作預測模型」則用來以姿勢和玩家控制訊號作為輸入,預測人物上一幀到下一幀的運動。

Starke等提出的系統架構圖,分別包含閘門網路模型和運動預測模型,以預測人物從上一幀到下一幀的運動。(圖片來源:S. Starke et al., 2020.)

其中,他們新定義了一種稱之為「局部動作相位」的特徵值作為閘門網路的輸入。局部動作相位其實指的就是從頭、手、腳等部分所擷取的局部動作,如此一來就可以更細緻地描述人物的動作,以幫助神經網路學習骨架和對手、環境之間的互動。而局部動作相位可以從資料庫中自動地擷取,完全不須人工標記。此外,Starke等也運用了生成控制模型(Generative Control Model),可以將玩家操作遊戲手把的抽象控制訊號轉換為各種明確的訊號,對應到逼真細微的角色動作。

成效與未來

Starke等將其成果以影片簡述,其中的人物在動作上確實栩栩如生,動作靈活流暢,玩家操作起來彷彿有如籃球高手上身,展現各種運球神技。然而,作者也坦言新方法目前還有許多進步的空間,例如:擴大生成控制模型的訓練資料範圍讓預測更準確、延伸局部運動相位到非接觸點的範圍等。就讓我們期待這樣的技術有朝一日能夠帶給玩家更精彩的遊戲體驗!

編譯來源

S. Starke et al., “[SIGGRAPH 2020] Local Motion Phases for Learning Multi-Contact Character Movements”, Youtube, 2020

參考資料

S. Starke et al., “Local Motion Phases for Learning Multi-Contact Character Movements”, SIGGRAPH, 2020

(本文由教育部補助「AI報報─AI科普推廣計畫」執行團隊編譯)